Randomiserung, was sind die Vorteile einer randomisierten Studie

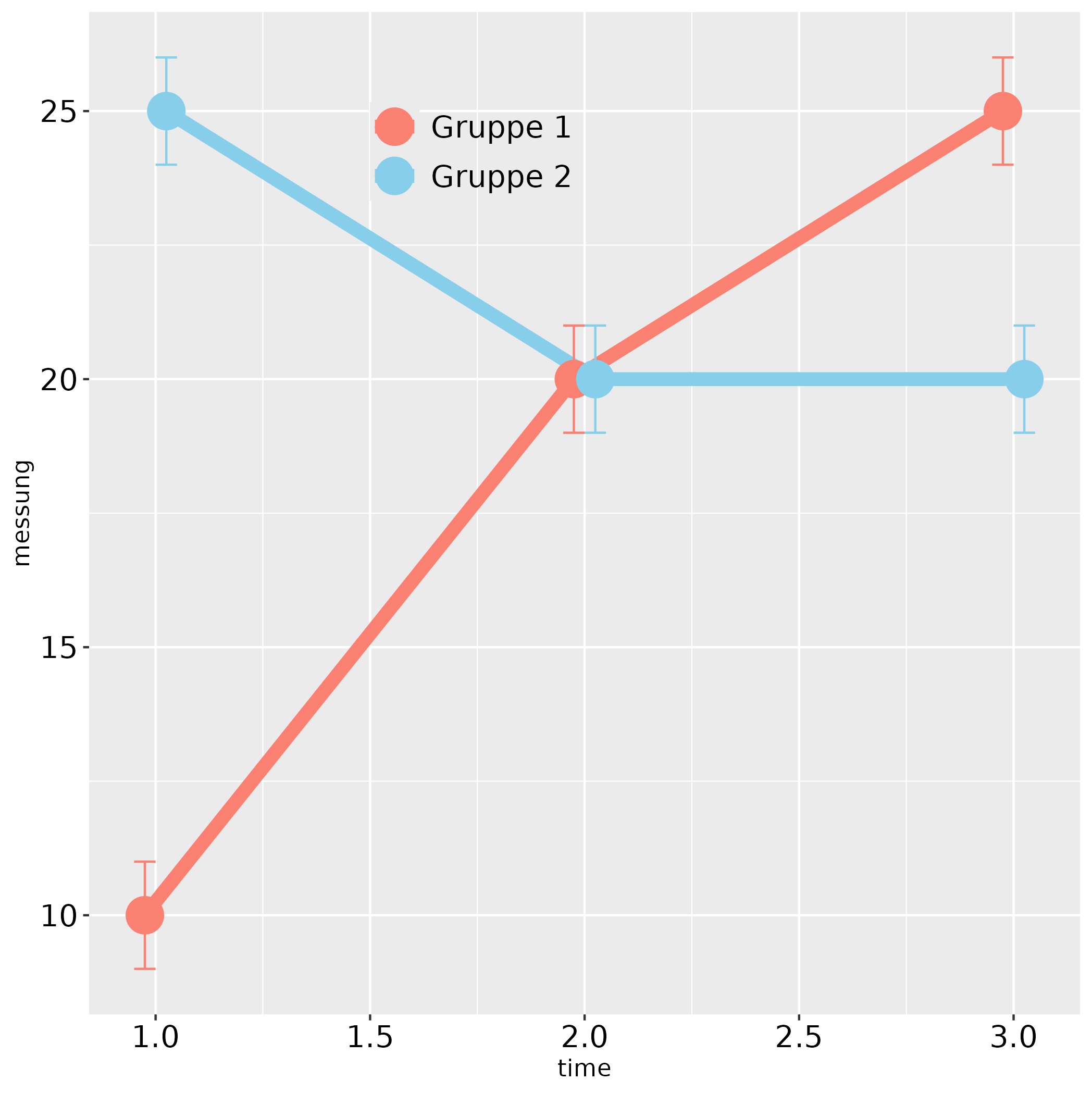

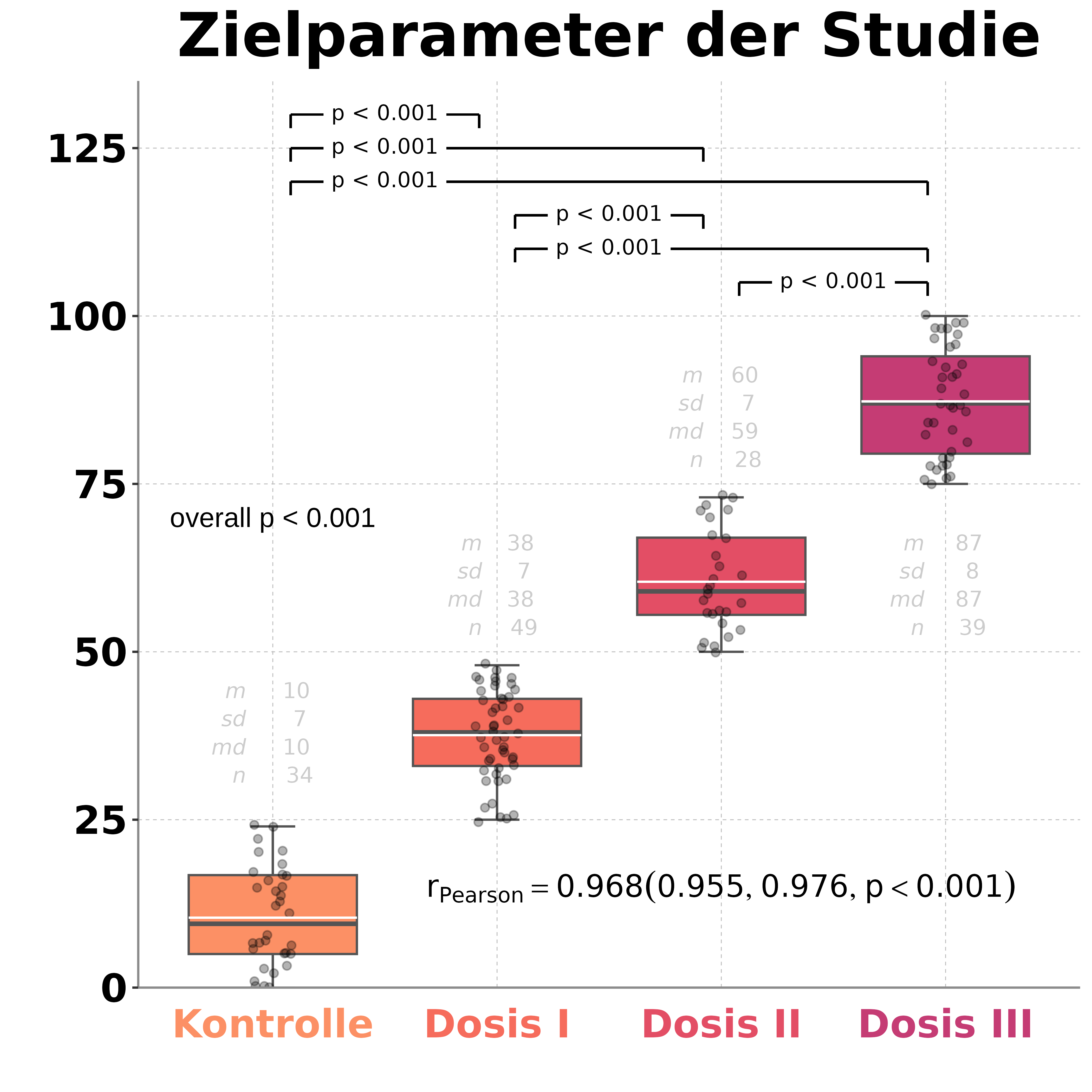

Vorteile der RandomisierungRandomisierte kontrollierte Studien (RCTs) gelten als „Goldstandard“. Das mag Viele verblüffen, sind sie in deren Vorstellung doch meist als weltfremde Grundlagenforschung ohne Praxisbezug (externe Validität) und Forschung im Elfenbeinturm verschrieen. Randomisierte kontrollierte Studien sind aber unverzichtbar, insbesondere, wenn man ernsthaft an der Kausalität interessiert ist, z.B. wenn man tatsächlich wissen möchte, ob eine Behandlung oder einer Intervention "wirkt". Grundlagenforschung ja, Anwendungsfälle in der Praxis müssen eben dann in Studienform noch "nachgeschoben" werden. Elfenbeinturm trifft definitiv nicht zu, denn beispielsweise alle zugelassenen Arzneimittel mußten eine solche Studie durchlaufen, d.h. hier hat man Klarheit, dass sie kausal wirken. Die zufällige Zuteilung zu verschiedenen Gruppen hat folgende Vorteile: Zufall heißt Nullkorrelation mit allem Übrigen, d.h. die Gruppierung korreliert mit nichts anderem, nicht mit Störfaktoren (Vorerkankungen, Gene, Lebensstil) oder Selektionsfaktoren (Alter, Geschlecht). Ein Selektionsbias (Bevorzugung) ist daher eliminiert, denn der Studienleiter hat ja keinen Einfluss darauf, wer der Studienteilnehmer in welcher Gruppe ist. Confounder, werden gleichmäßig verteilt. Diese Confounder wie Alter, Geschlecht, Genetik oder Lebensstil sind natürlich noch da, aber ihr Einfluß wird durch die randomisierte Gruppenzuteilung gleichmäßig verteilt (jede randomisierte Studie muss zeigen, ob das gelungen ist), d.h. sie werden balanciert. Damit werden die Gruppen besser vergleichbar. Andere Studiendesigns haben hiermit allergrößte Probleme und die Behauptung, dass eine Wirkung gelungen sei, wird oft bezweifelt und eher den Selektionseffekten und den übrigen Kovariaten zugeschrieben (bzw. umgekehrt: man es nicht ausschließen, dass Kovariaten die gezeigte Wirkung mitgetriggert haben, was eine solche Studie dann stark entwertet). Randomiserte Studien sind aktuell die einzigen Designs, mit denen mach Kausalität zeigen kann. Wenn sich die Gruppen nur noch durch die untersuchte Intervention unterscheiden und die Korrelation zu Störgrößen auf Null gesetzt wurden, können beobachtete Effekte direkt dann auf die Intervention zurückgeführt werden. D.h. Ursache-Wirkungs-Beziehungen sind damit gut untersuchbar und später auch interpretierbar, was bedeutet, dass die vorliegenden Ergebnisse auf andere Kollektive transferierbar sind, die man (noch) nicht kennt. Statistisch ist man außerdem auf der eher sicheren Seite, denn viele statistische Tests brauchen eine Zufallsverteilung als Grundlage. Randomiserte Studien können noch "geboostert" werden, denn mit einer Verblindung (weder Patient, noch der intervenierende Arzt wissen, um welche Gruppe bzw. Behandlung es geht). So stellt man sicher, dass keine speziellen Erwartungenhaltungen (auf beiden Seiten, bei Arzt oder Patient) das Ergebnis verfälschen. Fazit: Randomisierte Studien erlaubten eine objektive und eine kausale Wirksamkeitsbewertung von Therapien oder Interventionen. Aus Sicht von (Interventions-)zulassenden Behörden sind sie unverzichtbar. Und: Beim Lesen eines Papers ist es für das eigene Urteil hilfreich, wenn man weiß, dass die Störgrößen balanciert, d.h. mehr oder weniger (mit Blick auf die Hauptfrage) ausgeschalten sind. |